开篇引入

在人工智能浪潮席卷数字生活每一个角落的今天,“AI关爱助手”已不再只是一个温暖的概念,而正在成为重构人机交互范式的重要力量。从商汤绝影发布的家庭AI新成员“可悠”(Care U),到深圳技术大学团队的AI亲情陪伴产品“牵挂小方”,再到心忆科技的“心忆康康”,这些产品正以各自的方式回答一个核心问题:AI如何从冰冷的工具进化成有温度的家庭伙伴-11-2-13。许多技术学习者在接触这一领域时,常面临一个尴尬局面:会用现成的AI助手,却不懂背后的技术原理;听说了大模型和Agent,却搞不清它们之间到底是什么关系;面试时被问到端云协同、记忆框架等概念,答不出核心要点。本文将从痛点出发,循序渐进拆解AI关爱助手的技术架构,从核心概念到代码示例再到面试考点,帮你建立一条完整的技术认知链路。

一、痛点切入:为什么传统智能设备“不懂关爱”

先看一个最常见的场景:传统智能音箱接收指令“提醒我晚上吃药”,它能做到准时提醒,但如果你没吃药呢?它不会追问,不会关心,更不会把你的健康状态同步给家人。

传统实现方式的伪代码如下:

传统智能设备核心逻辑 class TraditionalAssistant: def __init__(self): self.tasks = [] 简单任务队列 self.user_profile = {} 基础用户画像 def process_command(self, command): 关键词匹配模式 if "提醒" in command: self.add_reminder(command) elif "播放" in command: self.play_music(command) 无法理解复杂语义,没有情感判断 def add_reminder(self, task): 只能做简单的时间提醒,无法判断用户实际状态 self.tasks.append(task)

这种实现方式的缺点非常明显:

耦合高:指令依赖关键词匹配,无法适应自然语言的多样性

无情感能力:只能理解字面意思,不能感知情绪、判断意图

记忆孤岛:每次交互都是独立的,无法积累对用户的长期了解

被动响应:只能“等你叫它”,不会主动关心

这些痛点的本质是:传统AI缺乏主动感知、深度理解、持续记忆的能力。而AI关爱助手的诞生,正是为了解决这些问题——让AI从“听懂指令”走向“读懂人心”。

二、核心概念讲解:AI Agent(智能体)

AI Agent,中文称“智能体”,英文全称为Artificial Intelligence Agent。它是指在复杂环境中能自主感知环境、理解目标、规划路径、执行动作并持续自适应的智能系统-63。

用生活化类比来理解:传统AI像一位“答录机”——你问什么它答什么;而AI Agent更像一位“私人助理”——它不仅能听懂你的需求,还能记住你的习惯、主动拆解任务、调用各种工具去帮你完成。你告诉它“帮我订一家适合家庭聚餐的餐厅”,它会自己、比价、预订、甚至付款-12。

在AI关爱助手体系中,Agent处于最核心的位置。它是连接“感知”与“行动”的决策大脑,决定了AI能否从“陪你聊天”进化到“帮你做事”。

三、关联概念讲解:大语言模型(LLM)

LLM,英文全称Large Language Model,中文为“大语言模型”。它是基于海量文本数据训练而成的深度学习模型,具备理解自然语言并生成类人回复的能力-。

那么LLM和AI Agent是什么关系?可以这样理解:

LLM是Agent的“大脑”——负责理解、推理、生成语言

Agent是包含“大脑+手脚”的完整系统——它用LLM理解任务,再调用外部工具去执行

用一个简单例子说明运行机制:

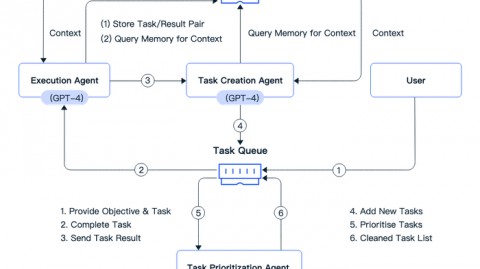

用户输入:“帮我安排一下明天的日程” ↓ Agent接收任务 ↓ LLM进行意图理解:识别出这是“日程规划”任务 ↓ Agent规划执行路径:调用日历API获取已有安排 → 调用推荐算法建议新事项 → 调用提醒服务设置通知 ↓ 执行并返回结果:“已为您安排上午9点会议,下午3点健身……”

没有Agent时,LLM只能告诉你“好的,我理解您的需求”,然后就没有然后了——它没有能力真正去“做事”。Agent的出现,填补了从“能说”到“会做”的关键空白-63。

四、概念关系与区别总结

| 维度 | 大语言模型(LLM) | AI Agent(智能体) |

|---|---|---|

| 角色定位 | 思考推理的“大脑” | 能思考+能行动的完整系统 |

| 核心能力 | 自然语言理解与生成 | 自主规划、工具调用、任务执行 |

| 交互方式 | 一问一答 | 持续对话+主动服务 |

| 记忆能力 | 上下文窗口内的短期记忆 | 长期记忆+外部存储 |

| 实际例子 | GPT、Qwen、Claude | 可悠、QClaw、康康 |

一句话高度概括:LLM是Agent的思考引擎,Agent是LLM的行动载体。学习时切勿将二者混为一谈——这是面试中的高频混淆点。

五、代码/流程示例:从零搭建一个简易关爱Agent

下面用Python演示一个简化版AI关爱助手的核心流程。示例展示了任务规划、工具调用和记忆管理三个关键能力。

简易AI关爱Agent核心框架 import json from typing import Dict, List class SimpleCareAgent: def __init__(self): 长期记忆:用户画像(可持久化到向量数据库) self.long_term_memory = { "user_name": "未知", "medication_reminder": None, "preferences": {} } 可用工具列表(Agent的“手脚”) self.tools = { "set_reminder": self._set_reminder, "get_weather": self._get_weather, "send_message": self._send_message } def perceive_and_reason(self, user_input: str) -> Dict: """感知用户输入并用LLM进行意图理解""" 实际项目中此处调用LLM API进行意图识别 示例:简化版意图解析逻辑 if "提醒" in user_input and "吃药" in user_input: return {"intent": "health_care", "params": {"type": "medication"}} elif "天气" in user_input: return {"intent": "daily_info", "params": {"type": "weather"}} elif "好冷" in user_input: return {"intent": "emotional_care", "params": {"type": "comfort"}} return {"intent": "unknown", "params": {}} def plan_and_execute(self, intent_result: Dict) -> str: """根据意图规划并执行任务""" intent = intent_result["intent"] params = intent_result["params"] if intent == "health_care": 规划步骤:设置提醒 → 记录到记忆 → 发送通知给家人 self.tools["set_reminder"](params) self.long_term_memory["medication_reminder"] = "已设置" self.tools["send_message"]("家人", "已为老人设置吃药提醒") return "好的,我会按时提醒您吃药,也已经通知了您的家人。" elif intent == "emotional_care": 情感关怀:主动问候 + 记忆关联 self.long_term_memory["last_interaction"] = "用户表达不适" return "听起来您不太舒服,需要我帮您联系家人吗?或者我陪您聊聊天?" return "我没太明白,可以再说一次吗?" def _set_reminder(self, params): """设置提醒的工具函数""" print(f"[Tool] 设置提醒: {params}") def _get_weather(self, params): """获取天气的工具函数""" print("[Tool] 查询天气中...") return "晴,15-25°C" def _send_message(self, recipient: str, content: str): """发送消息的工具函数""" print(f"[Tool] 发送消息给{recipient}: {content}") def run(self, user_input: str) -> str: """Agent主循环""" intent = self.perceive_and_reason(user_input) response = self.plan_and_execute(intent) return response 运行示例 agent = SimpleCareAgent() print(agent.run("今天好冷,身体不太舒服")) 输出: 听起来您不太舒服,需要我帮您联系家人吗?或者我陪您聊聊天?

关键步骤标注:

perceive_and_reason:感知层,通过LLM理解用户意图(对应“认识你”)long_term_memory:长期记忆,模拟Agent的“成长型记忆”tools:工具注册表,Agent的“手脚”,支持功能扩展plan_and_execute:规划执行层,Agent的核心决策逻辑

对比传统实现,可以看到AI关爱Agent的关键提升:能理解情绪、有长期记忆、能主动规划执行,而不是被动等待指令。

六、底层原理/技术支撑

AI关爱助手的技术落地,背后依赖几个核心底层能力:

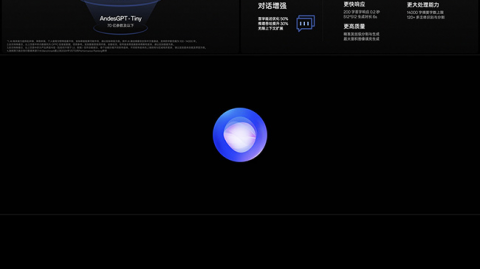

1. 端云协同架构:这是当前AI关爱助手的标准架构。以商汤“可悠”为例,端侧轻量化小模型负责实时感知(延迟<3秒),云端大模型负责深层意图理解与复杂任务规划-1。这种架构兼顾了实时响应与深度推理能力。

2. 生长型记忆框架:传统AI的记忆只做流水式信息存储,而新一代关爱助手建立了“会自主生长”的认知记忆引擎。通过持续积累用户的行为轨迹、情绪状态、家庭关系,AI能越来越了解你-1。

3. 情感计算与多模态融合:包括声纹识别(如“牵挂小方”仅需20秒语音即可提取128维声纹特征)、语音情感分析、面部表情识别等-2。大语言模型内部也开始涌现出可解释的情感表示空间-。

4. Agent工具链与MCP协议:AI Agent需要调用外部工具(查天气、发消息、订餐等)。2026年,MCP(Model Context Protocol)成为标准化方案,可以理解为AI模型的“USB接口”——任何支持MCP的AI都能即插即用各类工具和数据源-63。

这些底层技术共同支撑了AI关爱助手从“聊天工具”到“生活伙伴”的能力跃迁。篇幅有限,底层原理的深入剖析将在后续进阶文章中展开。

七、高频面试题与参考答案

Q1:请解释AI Agent与大语言模型(LLM)的区别与联系。

参考答案:LLM是Agent的核心组件之一,负责自然语言理解和生成。Agent则是一个更完整的系统,包含感知环境、规划任务、调用工具、执行动作、记忆管理等模块。类比来说,LLM是“大脑”,Agent是“大脑+手脚”的完整系统。没有Agent的LLM只能回答问题,有了Agent的LLM才能真正“做事”。

Q2:AI关爱助手的端云协同架构是如何设计的?为什么需要这种设计?

参考答案:端侧部署轻量化小模型,负责实时感知处理,保障低延迟(<3秒)响应和隐私数据本地化;云端部署大模型,负责深层意图理解、复杂任务规划和多轮对话管理。两者结合兼顾了实时性与深度智能,同时端侧处理敏感数据也符合隐私保护要求。

Q3:AI Agent如何实现长期记忆?核心技术有哪些?

参考答案:Agent的记忆分为工作记忆和外部记忆。工作记忆依赖大模型的上下文窗口(如100万token);外部记忆通过向量数据库存储历史交互,通过语义相似度检索相关信息。还有规则+LLM混合的记忆压缩策略来控制记忆增长,防止信息溢出-63。

Q4:情感计算在AI关爱助手中如何发挥作用?

参考答案:通过多模态感知(语音语调、面部表情、文本情绪)提取用户情绪特征,输入到情感识别模型判断情绪类别与强度。然后将情绪状态作为上下文输入给大模型,指导生成具有共情能力的回复。部分系统还会根据情绪状态调整服务策略,如在用户情绪低落时主动发起关怀。

Q5:AI关爱助手的本地部署为什么重要?

参考答案:第一,隐私保护——声纹、健康数据等敏感信息本地存储加密,不上传云端;第二,实时性——本地推理延迟低,保障流畅交互;第三,合规性——符合个人信息保护法的特殊保护要求-2。本地优先结合云端增强的混合架构是目前的主流方案。

八、结尾总结

回顾全文的核心知识点:

AI Agent与LLM是紧密关联但本质不同的概念:LLM是思考引擎,Agent是完整行动系统,切勿混淆。

端云协同是关爱助手的标准架构:端侧保证实时性,云端提供深度智能。

长期记忆+情感计算+工具调用构成了Agent从“能说”到“会做”的三大支柱。

本地部署优先是隐私与安全的重要保障,也是面试和工程落地的关键考量。

学习建议:先掌握LLM基础原理,再理解Agent架构,最后结合具体产品案例(如可悠、康康)消化工程细节。下一篇文章我们将深入AI Agent的核心架构——记忆管理模块的设计原理与实现方案,敬请期待。