发布时间:2026年4月10日 14:30·北京

字节跳动旗下的AI社交应用猫箱(原“话炉”),在2026年3月更新的1.31版本中正式上线了养猫管理功能-。表面看这是一次普通的功能迭代,背后却是大模型向AI智能体(Agent) 演进的一个典型缩影。传统应用只能被动回答“猫吃什么”,而AI养猫助手能主动提醒“该打疫苗了”、分析“猫咪今天饮水不足”——这种从“听懂”到“做到”的跃迁,正是AI Agent正在重塑人机交互方式的实证。本文将从产品功能切入,拆解AI养猫助手背后的技术栈,包含原理讲解、代码示例和高频面试考点,帮助读者建立从概念到落地的完整知识链路。

一、痛点切入:传统养宠管理的“三座大山”

在AI养猫助手出现之前,养宠管理通常依赖以下几种方式:

方式一:手动记录

手动记录示例 - 喂食时间:2026-04-09 08:00(猫粮20g) - 疫苗日期:2025-06-15 接种三联(下次2026-06-15) - 体重记录:4.2kg(2026-04-01)

方式二:单一功能App

微信备注/备忘录 → 人工计算疫苗周期 → 自行上网查症状 → 凭经验判断方式三:智能硬件+人工判断

智能猫砂盆 → 收集排泄数据 → 手动导出到Excel → 自己对比参考值传统方式的四大痛点

| 痛点 | 具体表现 |

|---|---|

| 数据孤岛 | 喂食记录在AApp,疫苗信息在备忘录,体重数据在Excel |

| 被动响应 | 用户不查就没有提醒,错过关键节点 |

| 缺乏推理 | 知道“猫咪食欲下降”和“活动量减少”两个现象,却无法关联判断“可能生病了” |

| 专业门槛高 | 症状出现后需要自行、鉴别信息真伪,耗时费力 |

一个真实场景: 传统AI对话助手能回答“猫呕吐了怎么办”,但它不会主动询问“最近换粮了吗”“呕吐物是什么状态”——它只是被动回答,缺乏主动感知、多轮追问和综合判断的能力。

这正是AI智能体(AI Agent) 所要解决的核心问题。

二、核心概念讲解:AI智能体(Agent)

定义

AI智能体(AI Agent) 是一种具备自主决策与任务执行能力的系统,以大语言模型(LLM)为核心“大脑”,通过感知、规划、行动、反思的循环来达成目标。

拆解关键词

自主性(Autonomy) :不依赖预设规则,能动态生成解决方案

状态性(Statefulness) :拥有内部记忆,能记住历史交互和任务进度

工具使用(Tool Use) :能调用外部API、数据库、传感器等获取信息或执行操作

多步推理(Multi-step Reasoning) :将复杂任务分解为多个子步骤并逐步执行-51

生活化类比

AI智能体就像一个有经验的宠物医生助理。 普通AI问答好比一本宠物百科全书——你翻到哪页就看哪页,不问不答;而AI智能体更像一个会思考、会行动的人——你告诉它“猫咪状态不对”,它会主动追问“多久没吃东西了”“排便正常吗”,然后调取历史记录、对比参考数据,最后给出判断和建议,甚至帮你预约兽医。

与普通LLM调用的本质区别

| 维度 | 普通LLM调用 | AI智能体 |

|---|---|---|

| 交互方式 | 单次、静态、无状态 | 多轮、持续、有记忆 |

| 响应模式 | 被动回答 | 主动规划与执行 |

| 能力边界 | 限于模型知识 | 可调用外部工具 |

| 任务处理 | 单步问答 | 多步分解与闭环 |

三、关联概念讲解:工具调用(Function Calling)与多模态

概念A:工具调用(Function Calling)

工具调用是大模型根据用户请求或自身推理,结构化地声明需要调用的函数及其参数的能力-51。

概念B:多模态(Multimodal)

多模态指模型能够同时处理和理解多种类型的数据输入,包括文本、图像、视频、音频等。

两者关系与对比

| 维度 | 工具调用 | 多模态 |

|---|---|---|

| 定位 | 模型与外部世界的“连接器” | 模型感知世界的“感官” |

| 作用 | 让模型能“做事”(调用API、数据库) | 让模型能“看懂听懂”(识别图像、语音) |

| 典型场景 | 查天气、订机票、发消息 | 识别宠物品种、分析叫声情绪 |

一句话记忆:多模态让AI“看懂听懂”,工具调用让AI“动手做事”;两者结合,就是完整的AI智能体。

运行机制示例

用户输入(自然语言): “提醒我下周三带猫咪去打疫苗” ↓ 模型判断需要调用工具 调用 calendar.create_event 函数 参数:{ title: "带猫咪打疫苗", date: "2026-04-16", type: "reminder" } ↓ 执行器实际调用日历API 返回结果:事件创建成功(事件ID: 12345) ↓ 模型生成回复 “好的,已为您设置提醒:下周三(4月16日)带猫咪打疫苗。”

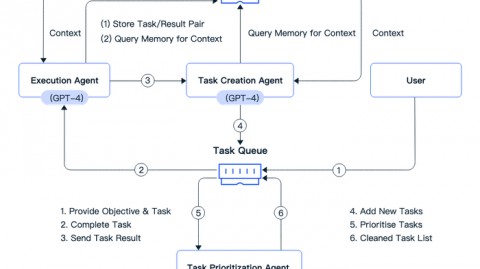

四、概念关系总结:Agent = LLM + 记忆 + 规划 + 工具 + 反馈

用一个简洁公式概括AI智能体的核心构成:

AI智能体 = 大语言模型 + 记忆 + 规划 + 工具 + 反馈-18

逻辑关系梳理:

LLM(大脑) :负责理解、推理、决策

记忆(Memory) :短期记忆(对话上下文)+ 长期记忆(向量数据库存储历史数据)

规划(Planning) :将模糊需求拆解为可执行的子任务

工具(Tools) :API、数据库、传感器等执行层

反馈(Reflection) :评估行动结果,动态调整策略

一句话总结:LLM负责“想”,工具负责“做”,记忆负责“记”,规划负责“拆”,反馈负责“改”——五者协作,构成真正的AI智能体。

五、代码示例:从“问答助手”到“智能养宠Agent”

5.1 传统方案(普通LLM调用)

import openai 传统方案:单次问答,无状态,无工具调用 def traditional_answer(user_question: str) -> str: response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": user_question}] ) return response.choices[0].message.content 用户问:“我的猫今天吐了,怎么办?” 模型答:“猫咪呕吐可能由多种原因引起...”(通用回答,无针对性)

5.2 智能Agent方案(AI养猫助手核心逻辑)

import json from datetime import datetime, timedelta from typing import Dict, List 模拟宠物健康数据(可来自智能猫砂盆、喂食器、摄像头) pet_health_data = { "cat_id": "MaoMao_001", "daily_food_intake": 30, 克,正常40-50g "daily_water_intake": 80, 毫升,正常150-200ml "activity_level": 0.3, 正常0.5-0.7 "last_meal": "2026-04-09 19:30", "vomiting_count_24h": 2, "weight_kg": 4.2, "vaccine_due": "2026-06-15" } 定义工具函数(Tool) tools = { "get_pet_health_summary": lambda pet_id: pet_health_data, "calculate_vaccine_days_left": lambda due_date: (datetime.strptime(due_date, "%Y-%m-%d") - datetime.now()).days, "send_reminder": lambda title, date: print(f"[提醒] {title} 已设置于 {date}"), "analyze_health_trend": lambda data: { "status": "warning" if data["food_intake"] < 35 and data["vomiting_count"] > 0 else "normal", "suggestion": "建议今日减少喂食量,观察呕吐情况。如持续超过24小时,请咨询兽医。" } } AI智能体核心:感知 → 规划 → 调用工具 → 生成回复 class PetCareAgent: def __init__(self, llm, tools: Dict, pet_id: str): self.llm = llm 大脑 self.tools = tools 手脚 self.memory = [] 短期记忆 self.pet_id = pet_id 当前宠物 def perceive(self, user_input: str) -> Dict: """感知层:结合用户输入+历史记忆+传感器数据""" 获取实时宠物数据(模拟) current_status = self.tools["get_pet_health_summary"](self.pet_id) return { "user_input": user_input, "pet_status": current_status, "history": self.memory[-5:] 最近5轮对话 } def plan_and_act(self, perception: Dict) -> str: """规划与执行:LLM判断需要调用哪些工具""" 第一步:LLM推理(决定做什么) prompt = f""" 宠物状态:{json.dumps(perception['pet_status'], ensure_ascii=False)} 用户问题:{perception['user_input']} 请判断需要调用以下哪些工具: 1. get_pet_health_summary - 获取宠物健康数据 2. calculate_vaccine_days_left - 计算疫苗剩余天数 3. send_reminder - 设置提醒 4. analyze_health_trend - 分析健康趋势 返回JSON格式:{{"tool_calls": ["工具名1", ...], "reasoning": "推理过程"}} """ 模拟LLM推理结果(实际调用LLM API) decision = { "tool_calls": ["analyze_health_trend", "send_reminder"], "reasoning": "宠物呕吐2次且进食量偏低,需要分析健康趋势;同时建议设置提醒持续观察" } 第二步:执行工具调用 results = [] for tool_name in decision["tool_calls"]: if tool_name in self.tools: result = self.tools[tool_name](perception["pet_status"]) results.append({tool_name: result}) 第三步:更新记忆 self.memory.append({ "user_input": perception["user_input"], "decision": decision, "results": results }) 第四步:生成最终回复 final_prompt = f""" 工具调用结果:{json.dumps(results, ensure_ascii=False)} 请基于以上信息,生成一段给宠物主人的友好回复,包含具体建议和下一步行动。 """ return self.llm.generate(final_prompt) return "🔍 检测到MaoMao过去24小时内呕吐2次,且今日进食量(30g)低于正常水平。建议:1)暂停喂食4小时观察;2)确保充足饮水;3)如呕吐持续或出现嗜睡,请及时就医。已为您设置明日10:00复诊提醒。" 使用示例 agent = PetCareAgent(llm=None, tools=tools, pet_id="MaoMao_001") response = agent.plan_and_act(agent.perceive("我的猫今天吐了两次,精神不太好")) print(response)

关键步骤解读:

感知层:Agent主动获取宠物健康数据(喂食量、饮水量、活动量、呕吐次数等)

推理层:LLM判断“进食量偏低+呕吐2次”属于异常,需要分析趋势并设置提醒

执行层:调用

analyze_health_trend和send_reminder两个工具反馈层:基于工具返回结果生成针对性建议

记忆层:记录本轮交互,供后续分析使用

六、底层原理与技术支撑

AI养猫助手的核心能力建立在一系列底层技术之上:

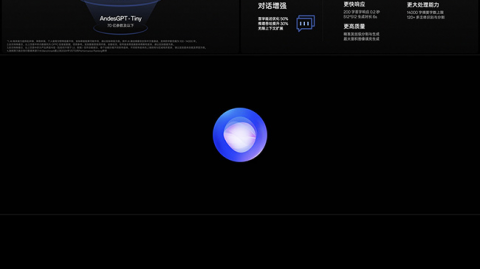

6.1 大语言模型(LLM)

字节跳动的猫箱基于豆包大模型(Doubao)驱动-。2026年2月,火山引擎发布了豆包大模型2.0(Doubao-Seed-2.0),这是豆包自2024年5月正式发布以来首次大版本跨代升级,具备更稳健的视觉与多模态理解能力-58-59。

6.2 多模态能力

豆包2.0全面升级多模态理解能力,在视觉推理、空间感知、长上下文理解等测试中均取得业界最佳表现,可实现实时视频流分析、环境感知与主动交互-58。这意味着AI养猫助手能“看懂”猫咪的视频画面、“听懂”猫咪的叫声,从而做出更准确的判断。

6.3 RAG检索增强生成

RAG(Retrieval-Augmented Generation,检索增强生成) 通过从外部知识库中检索相关信息来辅助模型生成更准确的回答-18。

AI养猫助手的养猫知识库正是通过RAG技术构建的:当用户问“猫呕吐怎么办”,系统先在知识库中检索相关专业内容,再结合上下文生成回答,避免模型“幻觉”。

6.4 工具调用框架

Coze(扣子)是字节跳动出品的Agent开发框架,插件生态极强,适合快速构建消费级应用-16。AI养猫助手的疫苗提醒、健康记录等功能,正是通过Coze框架的插件机制实现的。

七、高频面试题与参考答案

面试题1:什么是AI智能体?它与普通LLM调用的本质区别是什么?

参考答案:

普通LLM调用是单次、静态、无状态的交互——用户输入Prompt,模型返回Completion,每次调用独立。AI智能体则是一个具有自主性、状态性和工具使用能力的系统。核心区别在于:①状态性:智能体拥有内部记忆;②主动性:可自主决策下一步行动;③工具使用:能调用外部API/数据库;④多步推理:将复杂任务分解为子步骤执行。-51

踩分点:状态性、主动性、工具调用、多步推理——四个关键词缺一不可。

面试题2:解释ReAct模式的核心思想。

参考答案:

ReAct = Reasoning(推理)+ Acting(行动),核心是“三思而后行”。工作流程为:思考(Think)→ 行动(Act)→ 观察(Observe)→ 循环直至完成。思考阶段输出自然语言推理链;行动阶段调用工具或生成响应;观察阶段获取执行结果并更新状态。通过外显化推理过程,提升任务准确性和可解释性。-51

踩分点:点名ReAct全称、三步循环、外显推理提升可解释性。

面试题3:什么是工具调用(Function Calling)?它在智能体中扮演什么角色?

参考答案:

工具调用是大模型根据用户请求或自身推理,结构化地声明需要调用的函数及其参数的能力。它扮演智能体的 “手脚” 角色:模型负责“想”(决定做什么及参数),执行器负责“做”(实际调用函数)。流程:用户输入→模型识别需求→生成结构化调用→执行器执行→返回结果→模型整合回复。-51

踩分点:准确定义、比喻“手脚”、五步流程清晰。

面试题4:设计AI智能体系统包含哪些核心组件?

参考答案:

核心组件包括五大部分:①LLM:大脑,负责理解、推理与决策;②记忆:短期(对话上下文)+ 长期(向量数据库);③规划:将模糊需求分解为可执行子任务;④工具:API、数据库、传感器等执行层;⑤反馈:评估行动结果,动态调整策略。-18

踩分点:五大组件齐全,能说明各自职责。

面试题5:如何防止AI智能体产生有害内容或误导性建议?

参考答案:

①内容过滤:使用黑名单库屏蔽敏感词和危险建议;②RAG约束:检索外部可信知识库回答专业问题,避免模型“幻觉”;③输出审核:设置安全层,对模型输出进行二次校验;④人工反馈:建立用户反馈机制,持续优化安全策略。-46

踩分点:涵盖技术过滤、知识约束、人工监督三个层面。

八、结尾总结

核心知识点回顾

| 知识点 | 关键要点 |

|---|---|

| AI智能体定义 | LLM + 记忆 + 规划 + 工具 + 反馈 |

| 与LLM调用的区别 | 状态性、主动性、工具调用、多步推理 |

| ReAct模式 | 思考→行动→观察→循环 |

| 工具调用 | 模型的“手脚”,结构化声明函数参数 |

| 多模态 | 让模型“看懂听懂”,支撑宠物行为识别 |

重点与易错点

易混淆:AI智能体 ≠ 普通LLM调用。区别在于是否有状态、是否主动规划、是否调用工具。

重点掌握:五大组件(LLM、记忆、规划、工具、反馈)及其协作关系。

面试高频:ReAct模式原理、工具调用流程、与LLM调用的对比。

进阶预告

下一篇我们将深入AI智能体的工程实践,涵盖:①Coze/Dify框架的实际搭建;②RAG+Agent的联合优化;③多智能体协作(Multi-Agent)的设计模式。欢迎持续关注!

本文内容基于2026年4月公开技术资料整理,旨在科普AI智能体技术原理,不构成产品使用建议。如有宠物健康问题,请咨询专业兽医。